ceph介绍

Ceph基础介绍

Ceph是一个可靠地、自动重均衡、自动恢复的分布式存储系统,根据场景划分可以将Ceph分为三大块,分别是对象存储、块设备存储和文件系统服务。在虚拟化领域里,比较常用到的是Ceph的块设备存储,比如在OpenStack项目里,Ceph的块设备存储可以对接OpenStack的cinder后端存储、Glance的镜像存储和虚拟机的数据存储,比较直观的是Ceph集群可以提供一个raw格式的块存储来作为虚拟机实例的硬盘。

Ceph相比其它存储的优势点在于它不单单是存储,同时还充分利用了存储节点上的计算能力,在存储每一个数据时,都会通过计算得出该数据存储的位置,尽量将数据分布均衡,同时由于Ceph的良好设计,采用了CRUSH算法、HASH环等方法,使得它不存在传统的单点故障的问题,且随着规模的扩大性能并不会受到影响。

Ceph的核心组件

Ceph的核心组件包括Ceph OSD、Ceph Monitor和Ceph MDS。

Ceph OSD:OSD的英文全称是Object Storage Device,它的主要功能是存储数据、复制数据、平衡数据、恢复数据等,与其它OSD间进行心跳检查等,并将一些变化情况上报给Ceph Monitor。一般情况下一块硬盘对应一个OSD,由OSD来对硬盘存储进行管理,当然一个分区也可以成为一个OSD。

Ceph OSD的架构实现由物理磁盘驱动器、Linux文件系统和Ceph OSD服务组成,对于Ceph OSD Deamon而言,Linux文件系统显性的支持了其拓展性,一般Linux文件系统有好几种,比如有BTRFS、XFS、Ext4等,BTRFS虽然有很多优点特性,但现在还没达到生产环境所需的稳定性,一般比较推荐使用XFS。

伴随OSD的还有一个概念叫做Journal盘,一般写数据到Ceph集群时,都是先将数据写入到Journal盘中,然后每隔一段时间比如5秒再将Journal盘中的数据刷新到文件系统中。一般为了使读写时延更小,Journal盘都是采用SSD,一般分配10G以上,当然分配多点那是更好,Ceph中引入Journal盘的概念是因为Journal允许Ceph OSD功能很快做小的写操作;一个随机写入首先写入在上一个连续类型的journal,然后刷新到文件系统,这给了文件系统足够的时间来合并写入磁盘,一般情况下使用SSD作为OSD的journal可以有效缓冲突发负载。

Ceph Monitor:由该英文名字我们可以知道它是一个监视器,负责监视Ceph集群,维护Ceph集群的健康状态,同时维护着Ceph集群中的各种Map图,比如OSD Map、Monitor Map、PG Map和CRUSH Map,这些Map统称为Cluster Map,Cluster Map是RADOS的关键数据结构,管理集群中的所有成员、关系、属性等信息以及数据的分发,比如当用户需要存储数据到Ceph集群时,OSD需要先通过Monitor获取最新的Map图,然后根据Map图和object id等计算出数据最终存储的位置。

Ceph MDS:全称是Ceph MetaData Server,主要保存的文件系统服务的元数据,但对象存储和块存储设备是不需要使用该服务的。

查看各种Map的信息可以通过如下命令:ceph osd(mon、pg) dump

ceph-deploy安装ceph

基本环境

| 192.168.6.101 | ceph1 |

|---|---|

| 192.168.6.102 | ceph2 |

俩台机器都挂俩块盘,一块系统盘,一块osd

配hosts:

1 | [root@ceph1 ~]# vim /etc/hosts |

时间同步:

1 | ntpdate ntp1.aliyun.com |

允许无密码SSH登录:

1 | 在ceph1上执行 |

配置主机名:

1 | hostnamectl set-hostname ceph1 |

配置ceph.repo

1 | [root@ceph1 ~]# vim /etc/yum.repos.d/ceph.repo |

安装ceph-deploy:

1 | yum install -y https://dl.fedoraproject.org/pub/epel/epel-release-latest-7.noarch.rpm |

创建一个 Ceph 存储集群,它有一个 Monitor 和两个 OSD 守护进程

1 | mkdir /etc/ceph && cd /etc/ceph |

在ceph.conf中追加以下内容

1 | # 存储集群副本个数 |

管理节点和osd节点都需要安装ceph 集群:

1 | ceph-deploy install ceph1 ceph2 |

配置MON初始化:

1 | ceph-deploy mon create-initial |

查看ceph集群状态:

1 | [root@ceph1 ceph]# ceph -s |

开启监控模块

1 | ceph-deploy mgr create ceph1 |

在/etc/ceph/ceph.conf中添加

1 | [mgr] |

查看集群支持的模块

1 | [root@ceph1 ceph]# ceph mgr dump |

设置dashboard的ip和端口

1 | [root@ceph-node1 ceph]# ceph config-key put mgr/dashboard/server_addr 192.168.6.101 |

1 | [root@ceph1 ~]# netstat -tulnp |grep 7000 |

创建osd

删除磁盘数据

1 | [root@ceph1 ceph]# ceph-deploy disk zap ceph1 /dev/sdb |

创建osd(一共俩个)

1 | [root@ceph1 ceph]# ceph-deploy osd create ceph1 --data /dev/sdb |

ceph秘钥拷贝(主节点执行)及修改密钥权限

用 ceph-deploy 把配置文件和 admin 密钥拷贝到管理节点和 Ceph 节点,这样你每次执行 Ceph 命令行时就无需指定 monitor 地址和 ceph.client.admin.keyring 了

1 | [root@ceph1 ceph]# ceph-deploy admin ceph1 ceph2 |

修改密钥权限(所有节点上执行)

1 | [root@ceph1 ceph] # chmod +r /etc/ceph/ceph.client.admin.keyring |

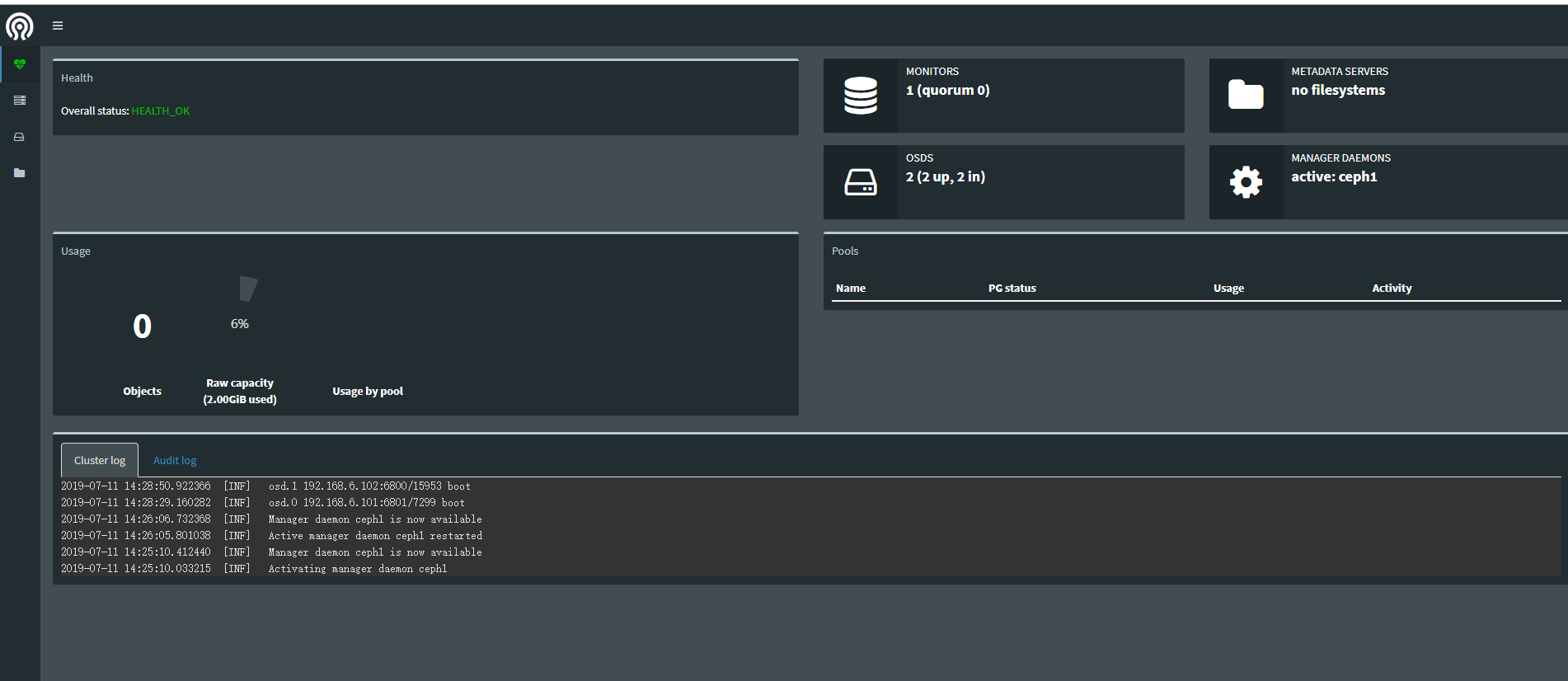

这时看下danshboard图: